回归问题的条件/前提:

1) 收集的数据

2) 如果的模型,即一个函数,这个函数里含有未知的參数,通过学习,能够预计出參数。然后利用这个模型去预測/分类新的数据。

1. 线性回归

如果 特征 和 结果 都满足线性。即不大于一次方。这个是针对 收集的数据而言。

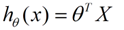

收集的数据中,每个分量,就能够看做一个特征数据。每个特征至少相应一个未知的參数。这样就形成了一个线性模型函数,向量表示形式:

这个就是一个组合问题,已知一些数据,怎样求里面的未知參数,给出一个最优解。 一个线性矩阵方程,直接求解,非常可能无法直接求解。有唯一解的数据集,微乎其微。

基本上都是解不存在的超定方程组。因此,须要退一步,将參数求解问题,转化为求最小误差问题,求出一个最接近的解,这就是一个松弛求解。

求一个最接近解,直观上,就能想到,误差最小的表达形式。仍然是一个含未知參数的线性模型,一堆观測数据,其模型与数据的误差最小的形式,模型与数据差的平方和最小:

这就是损失函数的来源。接下来,就是求解这个函数的方法,有最小二乘法,梯度下降法。

http://zh.wikipedia.org/wiki/%E7%BA%BF%E6%80%A7%E6%96%B9%E7%A8%8B%E7%BB%84最小二乘法

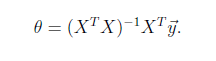

是一个直接的数学求解公式,只是它要求X是列满秩的,

梯度下降法

分别有梯度下降法,批梯度下降法,增量梯度下降。本质上,都是偏导数,步长/最佳学习率,更新,收敛的问题。这个算法仅仅是最优化原理中的一个普通的方法,能够结合最优化原理来学,就easy理解了。

2. 逻辑回归

逻辑回归与线性回归的联系、异同?

逻辑回归的模型 是一个非线性模型,sigmoid函数,又称逻辑回归函数。可是它本质上又是一个线性回归模型,由于除去sigmoid映射函数关系,其它的步骤,算法都是线性回归的。能够说,逻辑回归,都是以线性回归为理论支持的。

仅仅只是,线性模型,无法做到sigmoid的非线性形式,sigmoid能够轻松处理0/1分类问题。

另外它的推导含义:仍然与线性回归的最大似然预计推导同样,最大似然函数连续积(这里的分布,能够使伯努利分布,或泊松分布等其它分布形式),求导,得损失函数。

![\begin{align}J(\theta) = -\frac{1}{m} \left[ \sum_{i=1}^m y^{(i)} \log h_\theta(x^{(i)}) + (1-y^{(i)}) \log (1-h_\theta(x^{(i)})) \right]\end{align}](http://deeplearning.stanford.edu/wiki/images/math/f/a/6/fa6565f1e7b91831e306ec404ccc1156.png)

逻辑回归函数

表现了0,1分类的形式。

表现了0,1分类的形式。

应用举例:

是否垃圾邮件分类?

是否肿瘤、癌症诊断?

是否金融欺诈?

3. 一般线性回归

线性回归 是以 高斯分布 为误差分析模型; 逻辑回归 採用的是 伯努利分布 分析误差。

而高斯分布、伯努利分布、贝塔分布、迪特里特分布,都属于指数分布。

![]()

而一般线性回归,在x条件下,y的概率分布 p(y|x) 就是指 指数分布.

经历最大似然预计的推导,就能导出一般线性回归的 误差分析模型(最小化误差模型)。

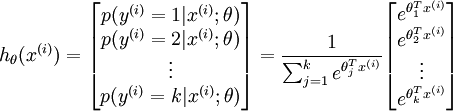

softmax回归就是 一般线性回归的一个样例。

有监督学习回归,针对多类问题(逻辑回归,解决的是二类划分问题),如数字字符的分类问题,0-9,10个数字,y值有10个可能性。

而这样的可能的分布,是一种指数分布。并且全部可能的和 为1,则对于一个输入的结果,其结果可表示为:

-

參数是一个k维的向量。而代价函数:

參数是一个k维的向量。而代价函数:![\begin{align}J(\theta) = - \frac{1}{m} \left[ \sum_{i=1}^{m} \sum_{j=1}^{k} 1\left\{y^{(i)} = j\right\} \log \frac{e^{\theta_j^T x^{(i)}}}{\sum_{l=1}^k e^{ \theta_l^T x^{(i)} }}\right]\end{align}](http://deeplearning.stanford.edu/wiki/images/math/7/6/3/7634eb3b08dc003aa4591a95824d4fbd.png)

而对于softmax的求解,没有闭式解法(高阶多项方程组求解),仍用梯度下降法,或L-BFGS求解。

当k=2时,softmax退化为逻辑回归,这也能反映softmax回归是逻辑回归的推广。

线性回归,逻辑回归,softmax回归 三者联系,须要重复回味,想的多了,理解就能深入了。

4. 拟合:拟合模型/函数

由測量的数据,预计一个假定的模型/函数。怎样拟合,拟合的模型是否合适?可分为下面三类

合适拟合

欠拟合

过拟合

看过一篇文章(附录)的图示,理解起来非常不错:

欠拟合:

合适的拟合

过拟合

过拟合的问题怎样解决?

问题起源?模型太复杂,參数过多,特征数目过多。

方法: 1) 降低特征的数量,有人工选择,或者採用模型选择算法

http://www.cnblogs.com/heaad/archive/2011/01/02/1924088.html (特征选择算法的综述)

2) 正则化,即保留全部特征,但减少參数的值的影响。正则化的长处是,特征非常多时,每一个特征都会有一个合适的影响因子。

5. 概率解释:线性回归中为什么选用平方和作为误差函数?

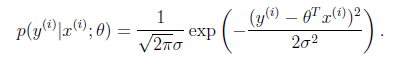

如果模型结果与測量值 误差满足,均值为0的高斯分布,即正态分布。这个如果是靠谱的,符合一般客观统计规律。

数据x与y的条件概率:

若使 模型与測量数据最接近,那么其概率积就最大。概率积,就是概率密度函数的连续积,这样,就形成了一个最大似然函数预计 。对最大似然函数预计进行推导,就得出了求导后结果: 平方和最小公式

。对最大似然函数预计进行推导,就得出了求导后结果: 平方和最小公式

6. 參数预计 与 数据的关系

拟合关系

7. 错误函数/代价函数/损失函数:

线性回归中採用平方和的形式,一般都是由模型条件概率的最大似然函数 概率积最大值,求导,推导出来的。

统计学中,损失函数一般有下面几种:

1) 0-1损失函数

L(Y,f(X))={ 1,0,Y≠f(X)Y=f(X)

2) 平方损失函数

L(Y,f(X))=(Y−f(X))2

3) 绝对损失函数

L(Y,f(X))=|Y−f(X)|

4) 对数损失函数

L(Y,P(Y|X))=−logP(Y|X)

损失函数越小,模型就越好,并且损失函数 尽量 是一个凸函数,便于收敛计算。

线性回归,採用的是平方损失函数。而逻辑回归採用的是 对数 损失函数。 这些不过一些结果,没有推导。

8. 正则化:

为防止过度拟合的模型出现(过于复杂的模型),在损失函数里添加一个每一个特征的惩处因子。这个就是正则化。如正则化的线性回归 的 损失函数:

lambda就是惩处因子。

正则化是模型处理的典型方法。也是结构风险最小的策略。在经验风险(误差平方和)的基础上,添加一个惩处项/正则化项。

线性回归的解,也从

θ=(XTX)−1XTy

转化为

括号内的矩阵,即使在样本数小于特征数的情况下,也是可逆的。

逻辑回归的正则化:

从贝叶斯预计来看,正则化项相应模型的先验概率,复杂模型有较大先验概率,简单模型具有较小先验概率。这个里面又有几个概念。

什么是结构风险最小化?先验概率?模型简单与否与先验概率的关系?

经验风险、期望风险、经验损失、结构风险

期望风险(真实风险),可理解为 模型函数固定时,数据 平均的 损失程度,或“平均”犯错误的程度。 期望风险是依赖损失函数和概率分布的。

仅仅有样本,是无法计算期望风险的。

所以,採用经验风险,对期望风险进行预计,并设计学习算法,使其最小化。即经验风险最小化(Empirical Risk Minimization)ERM,而经验风险是用损失函数来评估的、计算的。

对于分类问题,经验风险,就训练样本错误率。

对于函数逼近,拟合问题,经验风险,就平方训练误差。

对于概率密度预计问题,ERM,就是最大似然预计法。

而经验风险最小,并不一定就是期望风险最小,无理论根据。仅仅有样本无限大时,经验风险就逼近了期望风险。

怎样解决问题? 统计学习理论SLT,支持向量机SVM就是专门解决问题的。

有限样本条件下,学习出一个较好的模型。

因为有限样本下,经验风险Remp[f]无法近似期望风险R[f] 。因此,统计学习理论给出了二者之间的关系:R[f] <= ( Remp[f] + e )

而右端的表达形式就是结构风险,是期望风险的上界。而e = g(h/n)是置信区间,是VC维h的增函数,也是样本数n的减函数。

VC维的定义在 SVM,SLT中有具体介绍。e依赖h和n,若使期望风险最小,仅仅需关心其上界最小,即e最小化。所以,须要选择合适的h和n。这就是结构风险最小化Structure Risk Minimization,SRM.

SVM就是SRM的近似实现,SVM中的概念另有一大筐。就此打住。

1范数,2范数 的物理意义:

范数,能将一个事物,映射到非负实数,且满足非负性,齐次性,三角不等式。是一个具有“长度”概念的函数。

1范数为什么能得到稀疏解?

压缩感知理论,求解与重构,求解一个L1范数正则化的最小二乘问题。其解正是 欠定线性系统的解。

2范数为什么能得到最大间隔解?

2范数代表能量的度量单位,用来重构误差。

以上几个概念理解须要补充。

9. 最小描写叙述长度准则:

即一组实例数据,存储时,利用一模型,编码压缩。模型长度,加上压缩后长度,即为该数据的总的描写叙述长度。最小描写叙述长度准则,就是选择 总的描写叙述长度最小的模型。

最小描写叙述长度MDL准则,一个重要特性就是避免过度拟合现象。

如利用贝叶斯网络,压缩数据,一方面, 模型自身描写叙述长度 随模型复杂度的添加而添加 ; 还有一方面, 对数据集描写叙述的长度随模型复杂度的添加而下降。因此, 贝叶斯网络的 MD L总是力求在模型精度和模型复杂度之间找到平衡。当模型过于复杂时,最小描写叙述长度准则就会其作用,限制复杂程度。

奥卡姆剃刀原则:

假设你有两个原理,它们都能解释观測到的事实,那么你应该使用简单的那个,直到发现很多其它的证据。

万事万物应该尽量简单,而不是更简单。

11. 凸松弛技术:

将组合优化问题,转化为易于求解极值点的凸优化技术。凸函数/代价函数的推导,最大似然预计法。

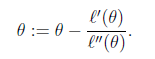

12. 牛顿法求解 最大似然预计

前提条件:求导迭代,似然函数可导,且二阶可导。

迭代公式:

若是 向量形式,

![]()

H就是 n*n 的hessian矩阵了。

特征:当靠近极值点时,牛顿法能高速收敛,而在远离极值点的地方,牛顿法可能不收敛。 这个的推导?

这点是与梯度下降法的收敛特征是相反的。

线性与非线性:

线性,一次函数;非线性,输入、输出不成正比,非一次函数。

线性的局限性:xor问题。线性不可分,形式:

x 0

0 x

而线性可分,是仅仅用一个线性函数,将数据分类。线性函数,直线。

线性无关:各个独立的特征,独立的分量,无法由其它分量或特征线性表示。

核函数的物理意义:

映射到高维,使其变得线性可分。什么是高维?如一个一维数据特征x,转换为(x,x^2, x^3),就成为了一个三维特征,且线性无关。一个一维特征线性不可分的特征,在高维,就可能线性可分了。

逻辑回归logicalistic regression 本质上仍为线性回归,为什么被单独列为一类?

其存在一个非线性的映射关系,处理的通常是二元结构的0,1问题,是线性回归的扩展,应用广泛,被单独列为一类。

并且假设直接应用线性回归来拟合 逻辑回归数据,就会形成非常多局部最小值。是一个非凸集,而线性回归损失函数 是一个 凸函数,即最小极值点,即是全局极小点。模型不符。

若採用 逻辑回归的 损失函数,损失函数就能形成一个 凸函数。

多项式样条函数拟合

多项式拟合,模型是一个多项式形式;样条函数,模型不仅连续,并且在边界处,高阶导数也是连续的。优点:是一条光滑的曲线,能避免边界出现震荡的形式出现(龙格线性)

http://baike.baidu.com/view/301735.htm下面是几个需慢慢深入理解的概念:

无结构化预測模型

结构化预測模型

什么是结构化问题?

adaboost, svm, lr 三个算法的关系。

三种算法的分布相应 exponential loss(指数 损失函数), hinge loss, log loss(对数损失函数), 无本质差别。应用凸上界代替0、1损失,即凸松弛技术。从组合优化到凸集优化问题。凸函数,比較easy计算极值点。

正则化与贝叶斯參数预计的联系?

部分參考文章:

http://www.guzili.com/?p=45150

http://52opencourse.com/133/coursera%E5%85%AC%E5%BC%80%E8%AF%BE%E7%AC%94%E8%AE%B0-%E6%96%AF%E5%9D%A6%E7%A6%8F%E5%A4%A7%E5%AD%A6%E6%9C%BA%E5%99%A8%E5%AD%A6%E4%B9%A0%E7%AC%AC%E4%B8%83%E8%AF%BE-%E6%AD%A3%E5%88%99%E5%8C%96-regularization

http://www.cnblogs.com/jerrylead/archive/2011/03/05/1971867.html